[CL]《Why Fine-Tuning Encourages Hallucinations and How to Fix It》G Kaplan, Z Gekhman, Z Zhu, L Rozner… [Hebrew University of Jerusalem & Technion – Israel Institute of Technology & University of Illinois Urbana-Champaign] (2026)

在大语言模型的微调领域,幻觉问题是一个悬而未决的难题。现有方法试图通过对齐训练来纠正错误输出,却始终未能触及根本——模型在学习新事实时,会系统性地遗忘预训练阶段已掌握的知识,而这一"遗忘机制"本身才是幻觉的真正产房。

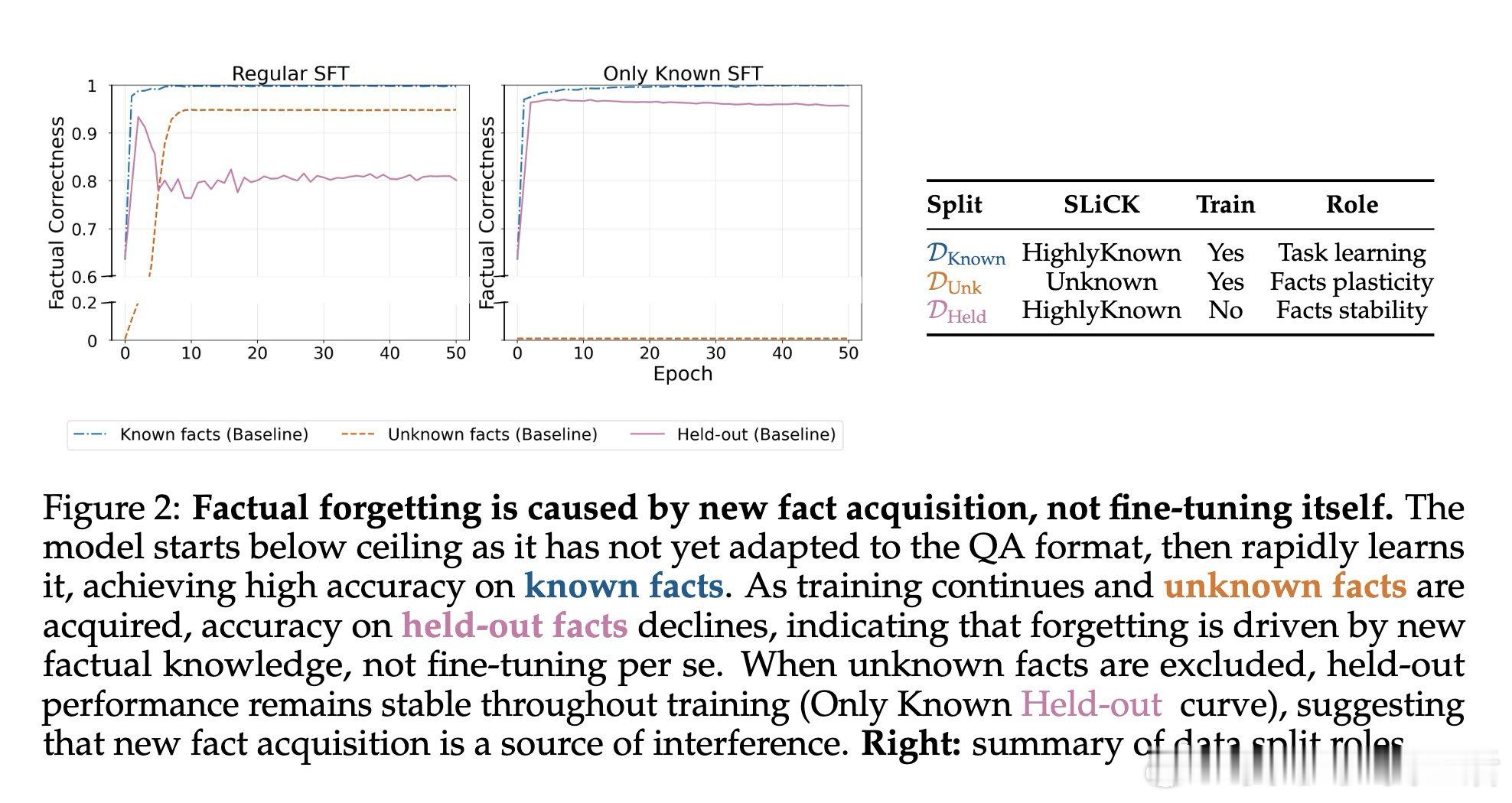

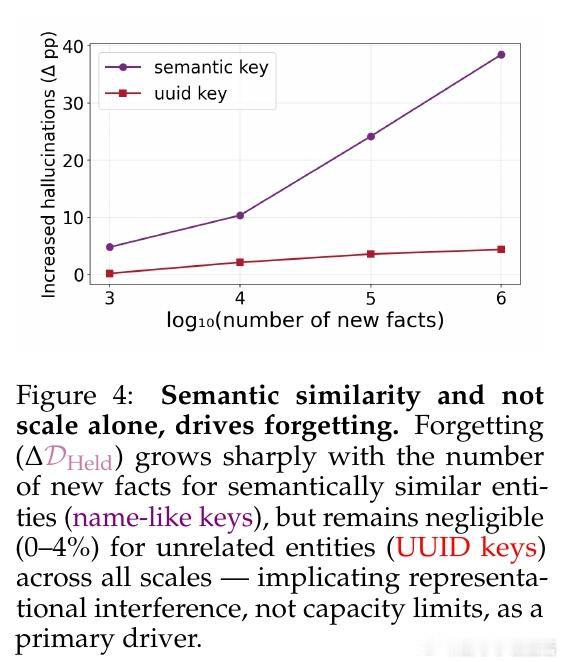

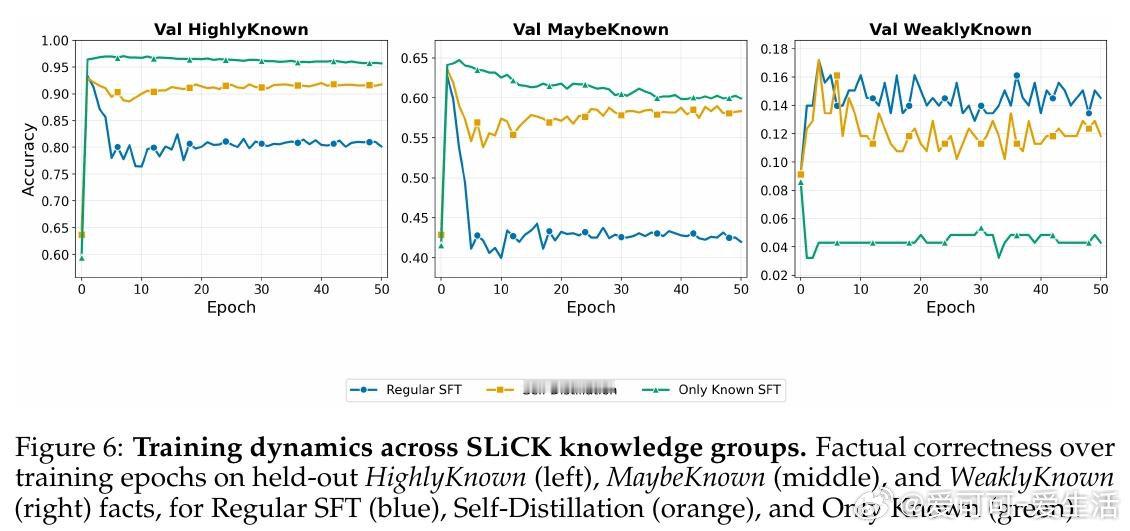

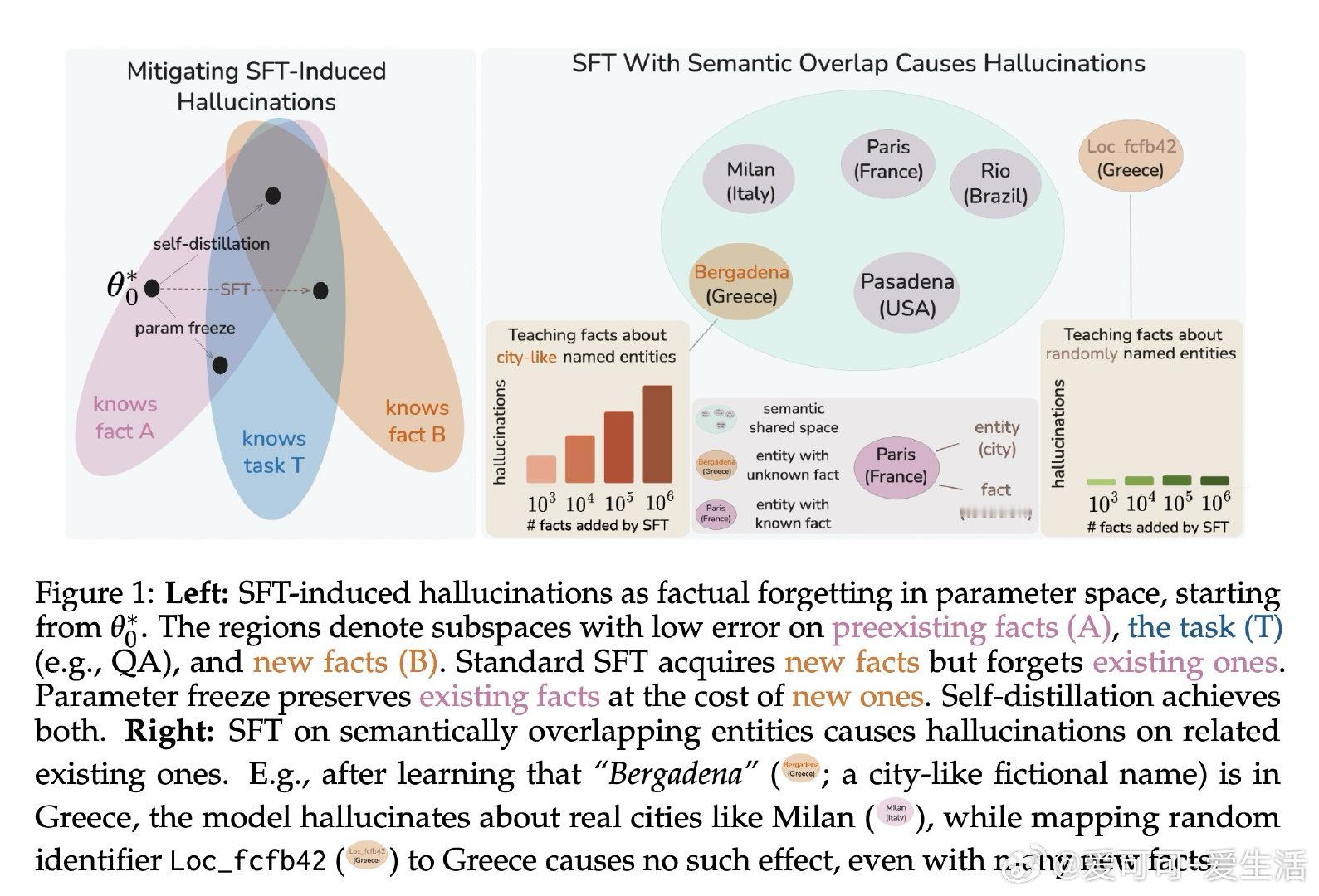

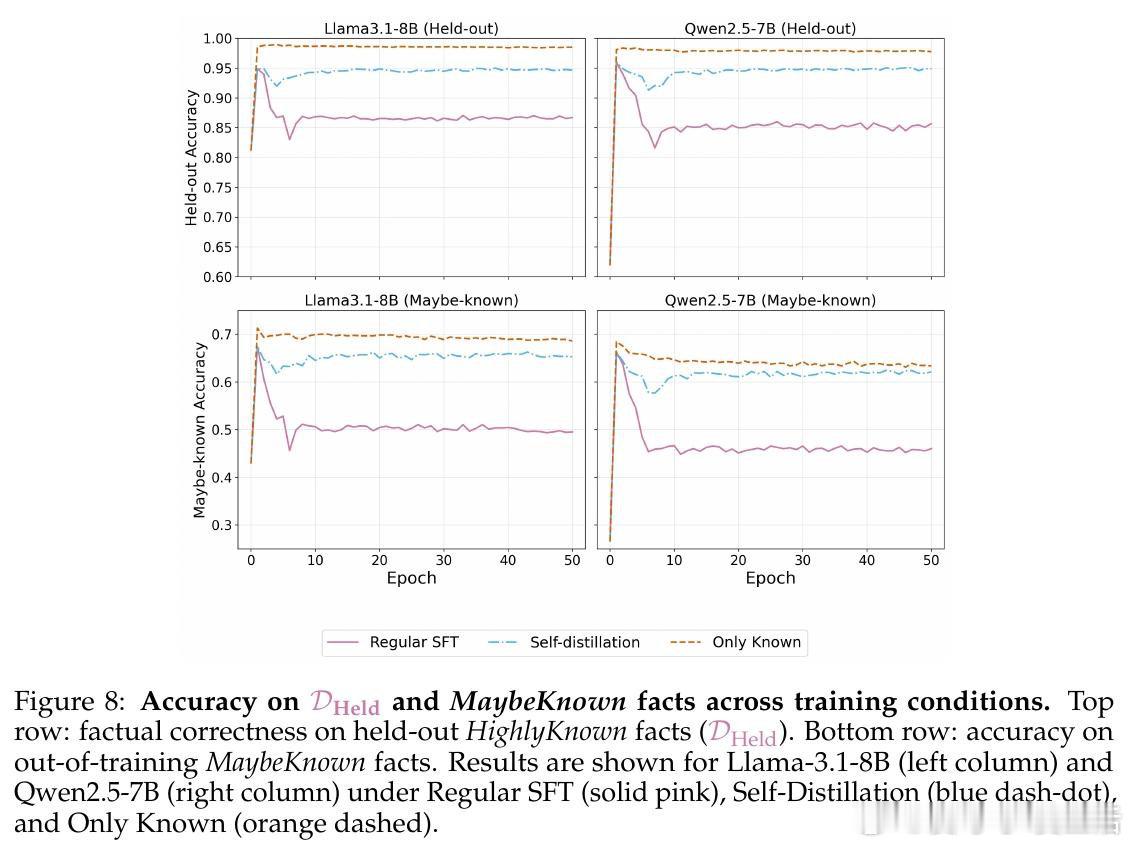

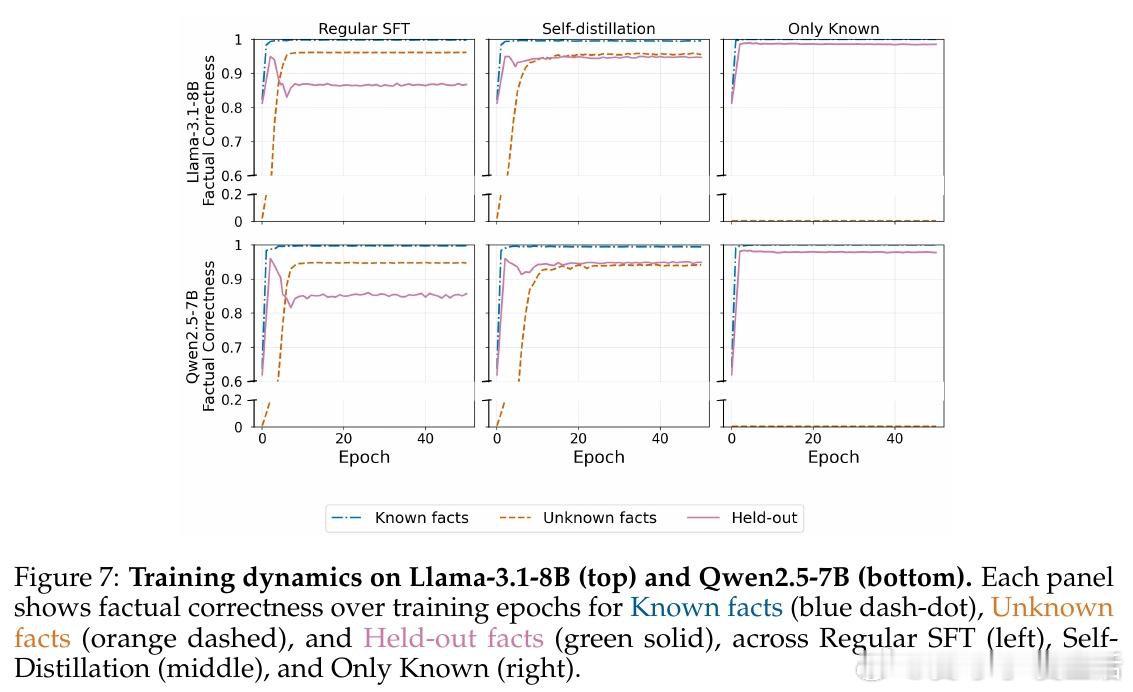

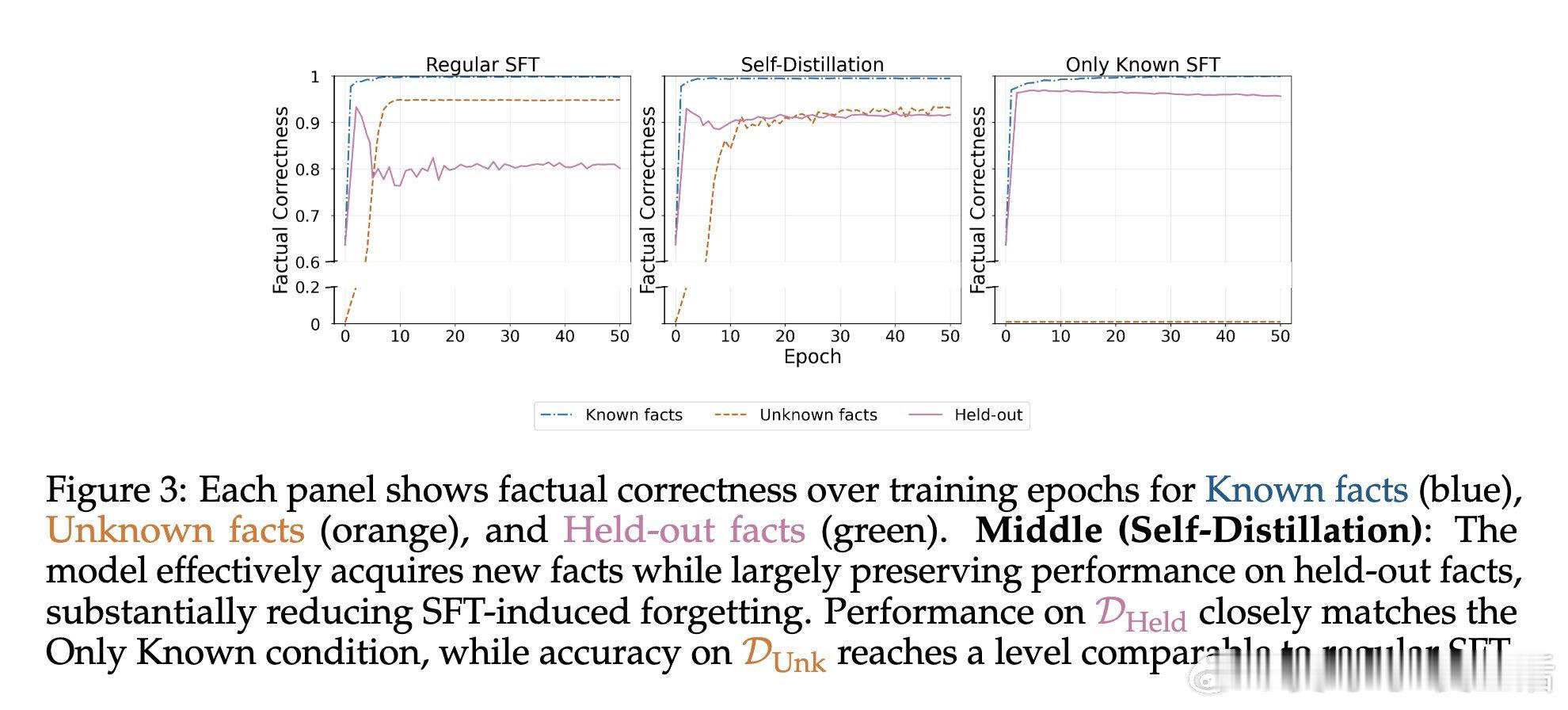

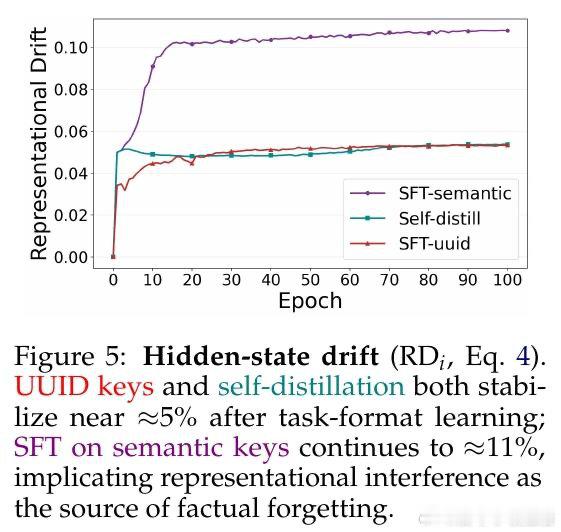

本文的核心洞见是:把微调诱发的幻觉重新看作一种持续学习中的"事实遗忘"。由此,将自蒸馏约束引入微调过程这一关键操作使问题得以解开——通过让学生模型的输出分布不偏离冻结教师模型,梯度更新被阻止沿语义重叠的表征区域传播,从而将遗忘率从约15%压缩至约3%,同时不牺牲新知识的获取能力。

这项工作真正留下的遗产是:将"事实稳定性"确立为微调的一等目标,并证明持续学习工具箱可以直接移植到幻觉治理中。它为后来者打开的新门是:针对语义重叠程度动态调整正则化强度,乃至在预训练阶段就主动规划表征邻域以减少未来干扰。但尚未跨过的门槛是:当前方案仍依赖离线快照作为教师,对于持续在线更新的场景,如何实时维护事实稳定性与塑性之间的动态平衡,尚无答案。

arxiv.org/abs/2604.15574

机器学习 人工智能 论文 AI创造营