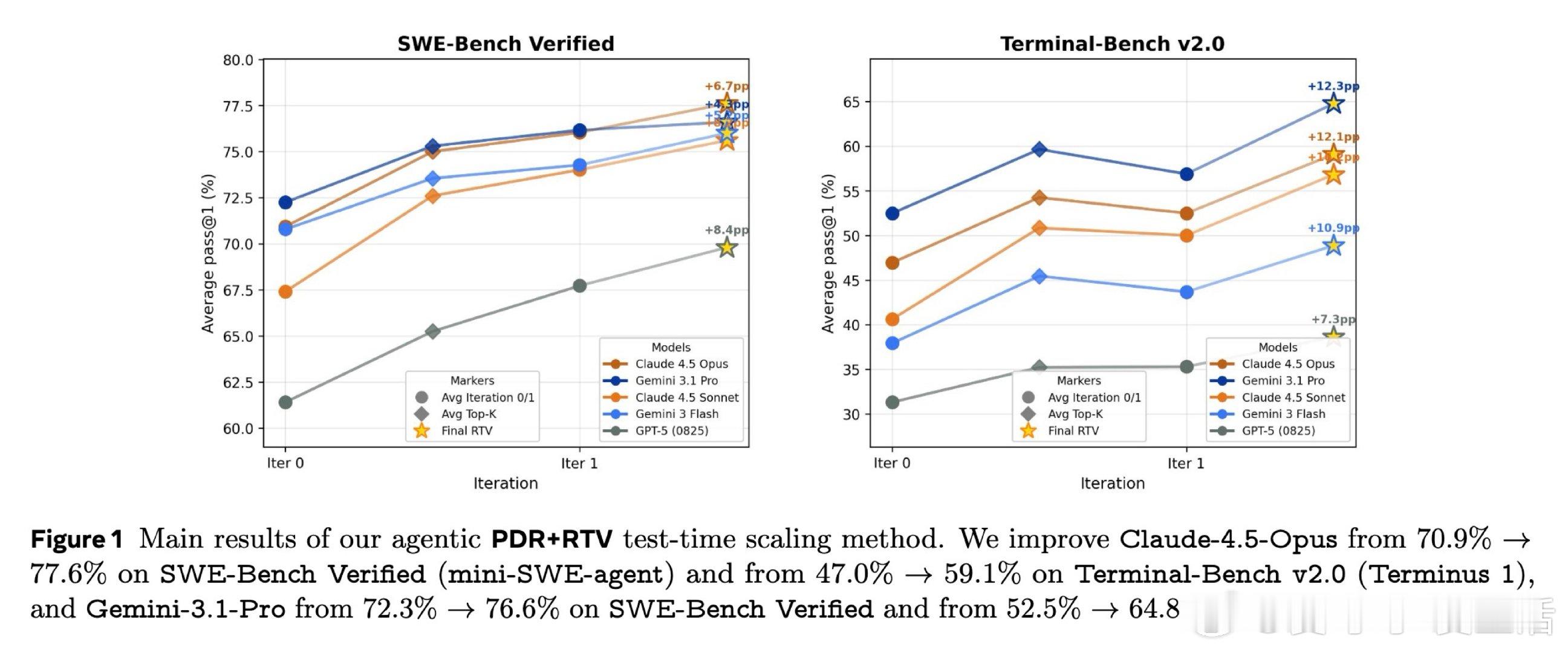

[LG]《Scaling Test-Time Compute for Agentic Coding》J Kim, W Yang, K Niu, H Zhang… [Meta Superintelligence Labs] (2026)

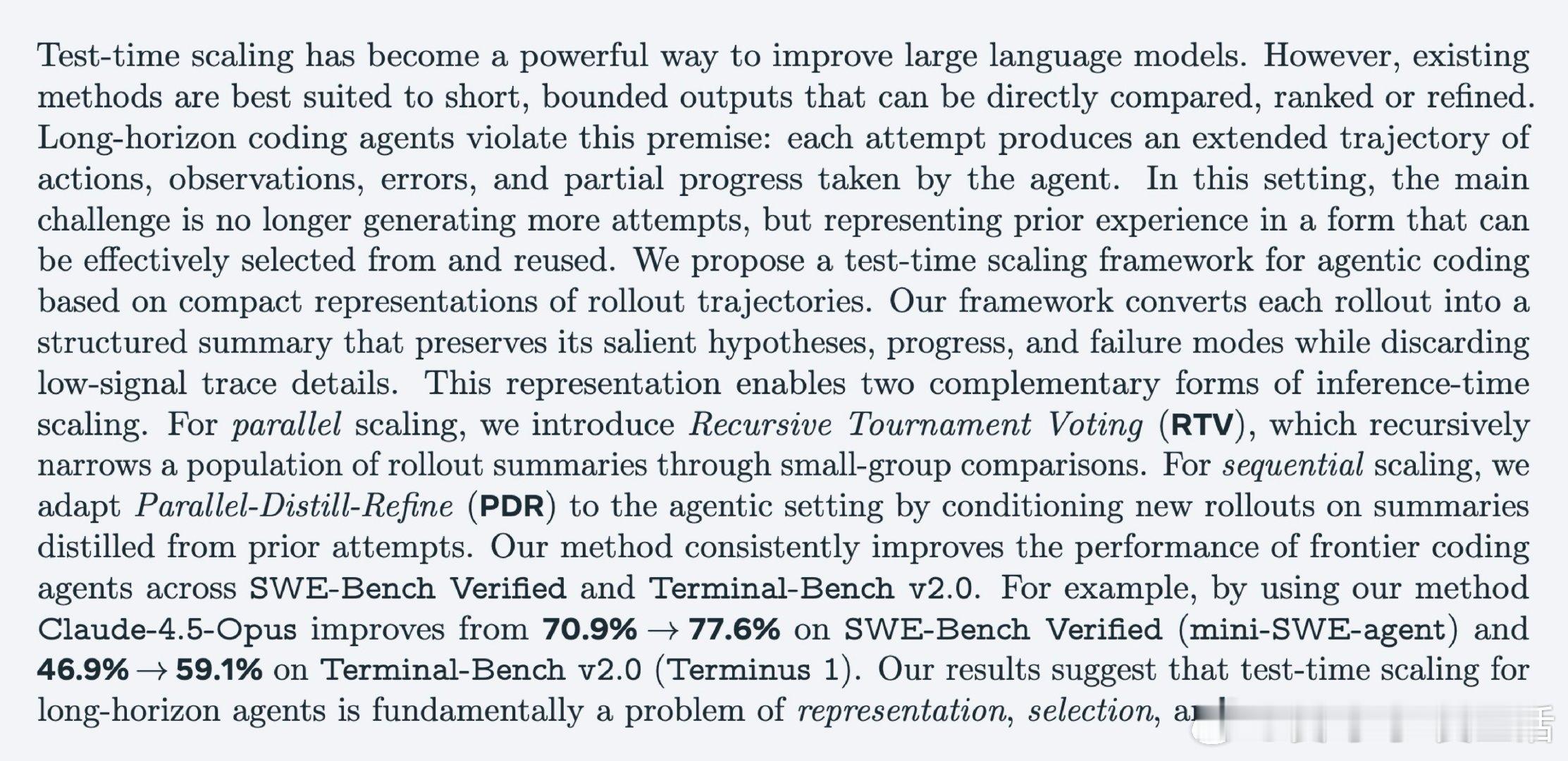

在代码智能体领域,试验时计算缩放(test-time scaling)是一个悬而未决的难题。过去的方法受困于轨迹过长、噪声过多,本质原因是原始交互记录既难以比较,又难以复用。

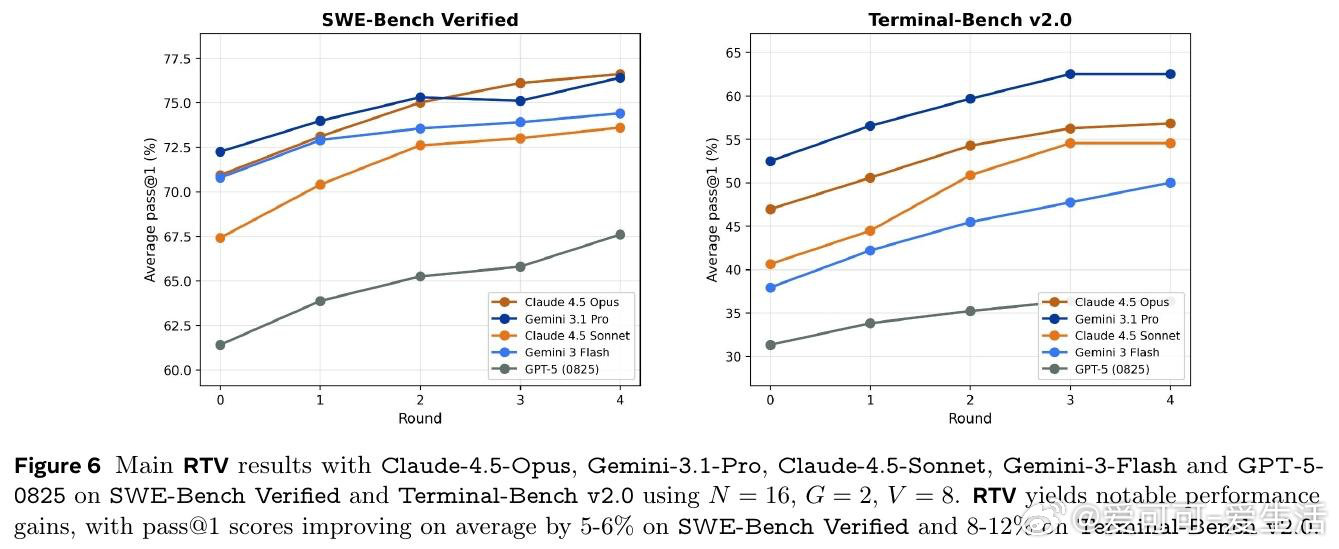

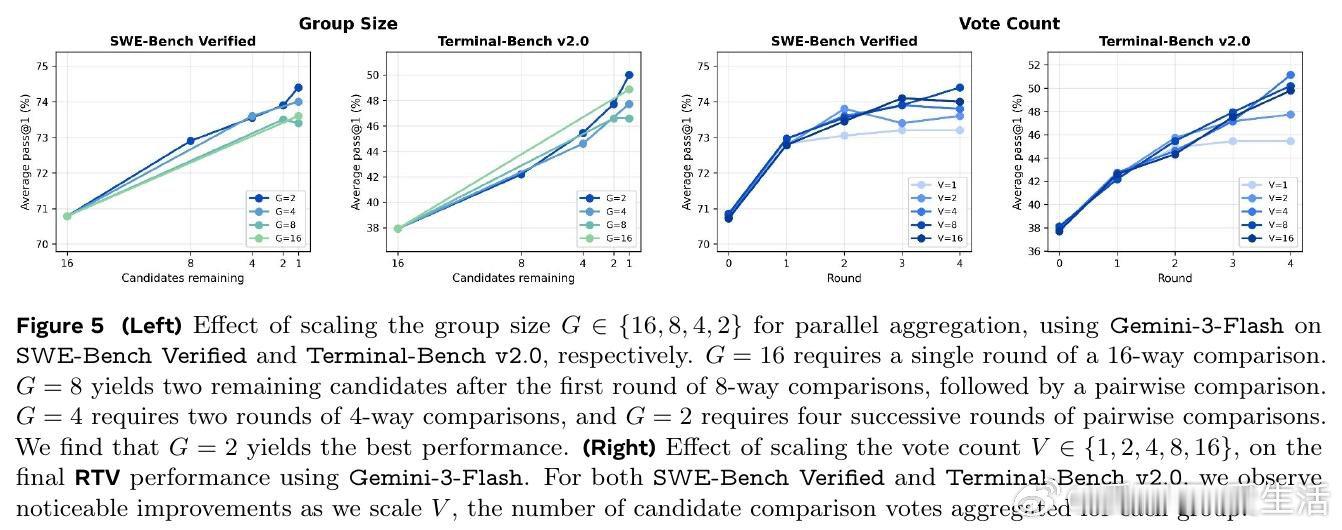

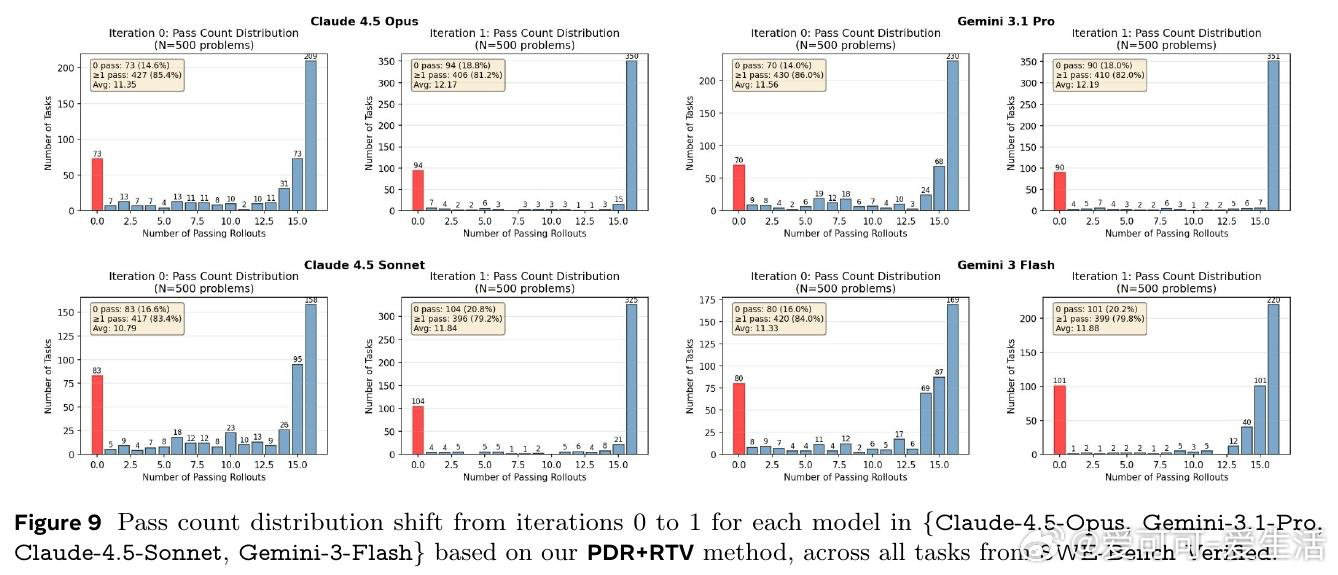

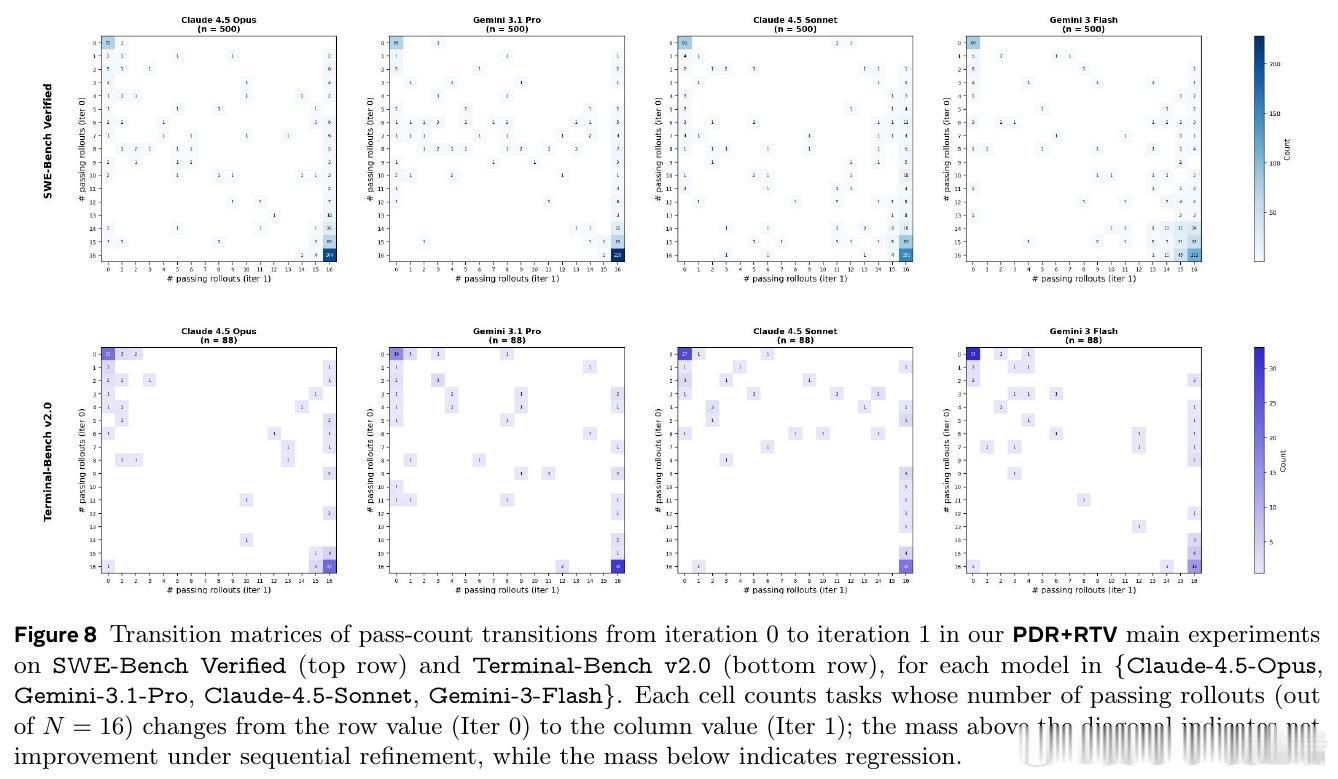

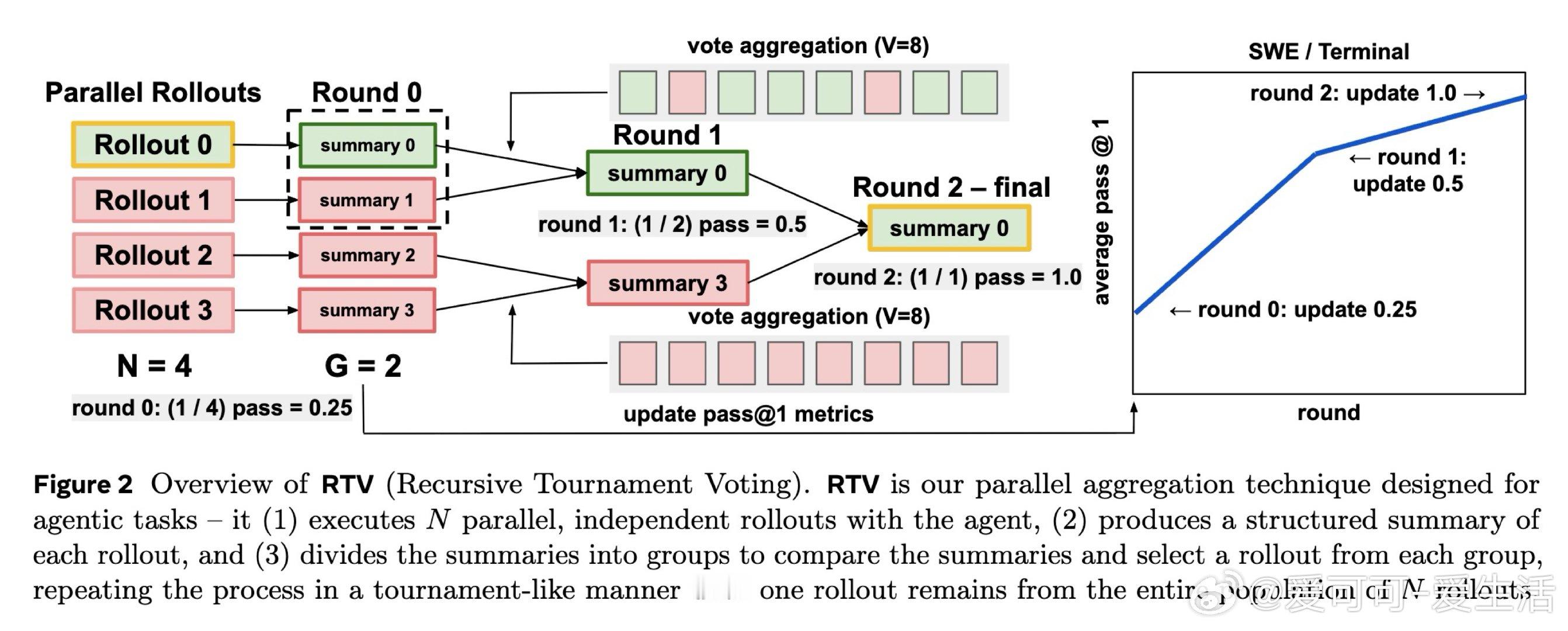

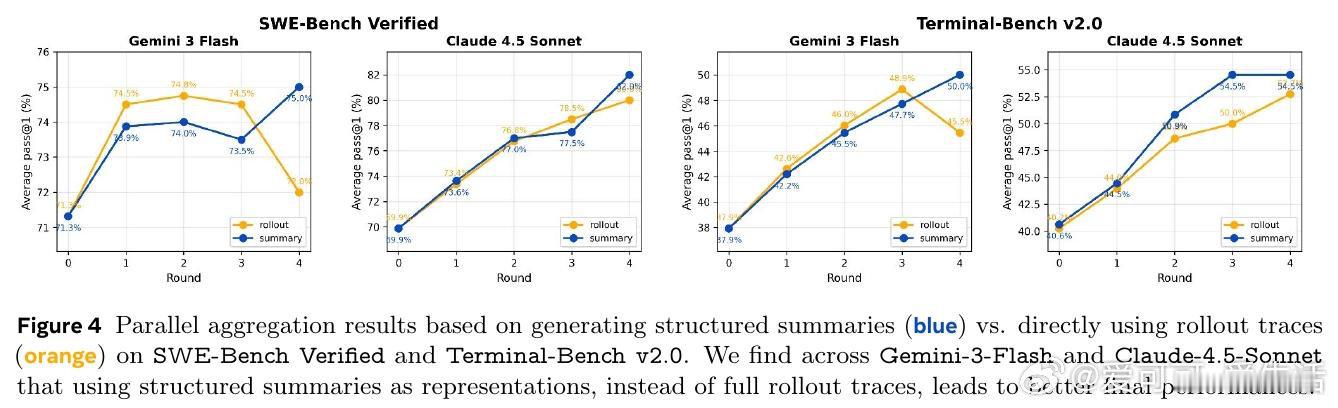

本文的核心洞见是:把智能体的执行轨迹重新看作可蒸馏的知识载体。由此,将每条轨迹压缩为结构化摘要这一关键操作使问题得以解开——摘要保留假设、进展与失败模式,丢弃低价值细节,成为并行筛选(RTV递归竞标投票)和顺序精炼(PDR蒸馏再执行)的共同接口。

这项工作真正留下的遗产是:证明长程智能体的推理时缩放,本质上是一个表示、选择与复用的问题,而非单纯的计算堆叠。它为后来者打开的新门是——如何构建更优质的轨迹摘要(乃至持久化工作空间状态)以跨次尝试积累经验;但尚未跨过的门槛是:当初始轨迹全部失败时,摘要质量趋近于零,后续精炼的收益随之崩塌,如何在这一极端情形下仍能提供有效引导,仍是开放问题。

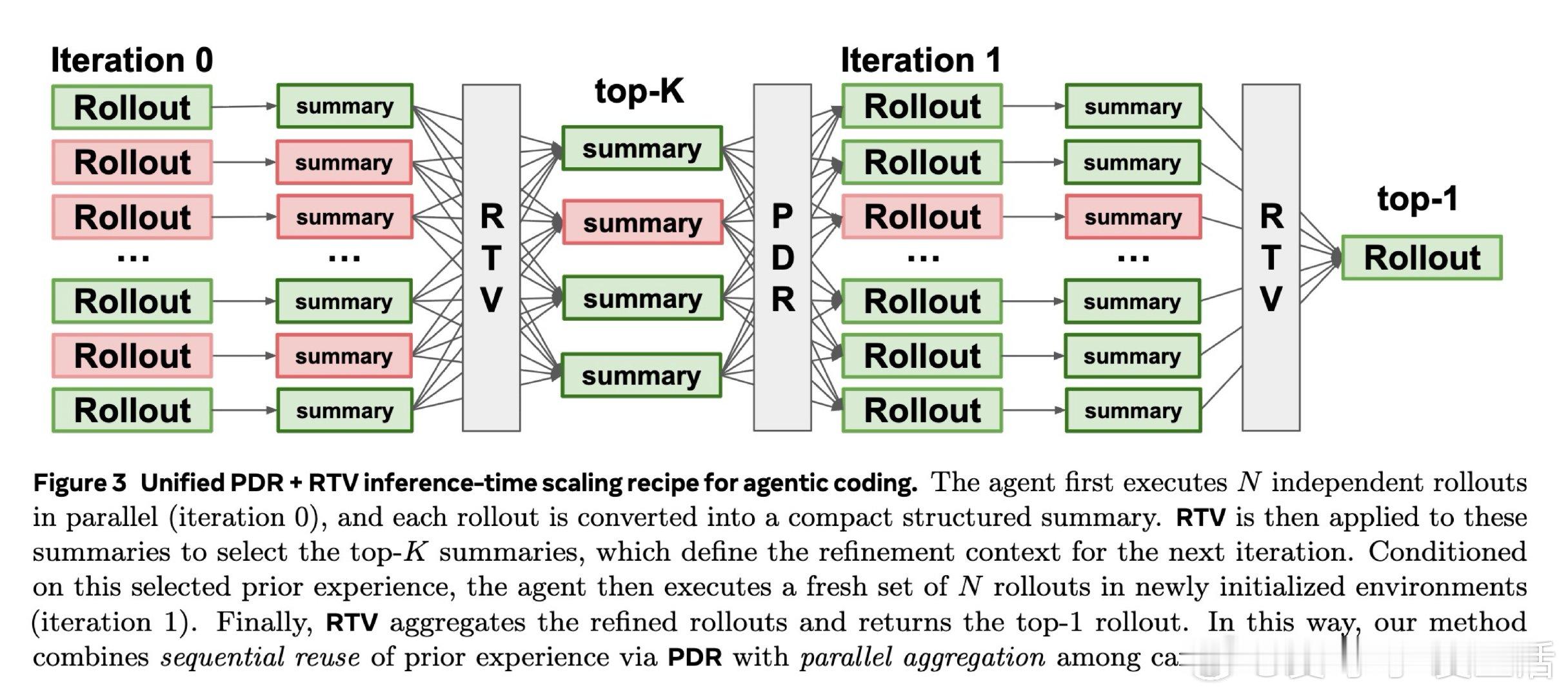

arxiv.org/abs/2604.16529

机器学习 人工智能 论文 AI创造营