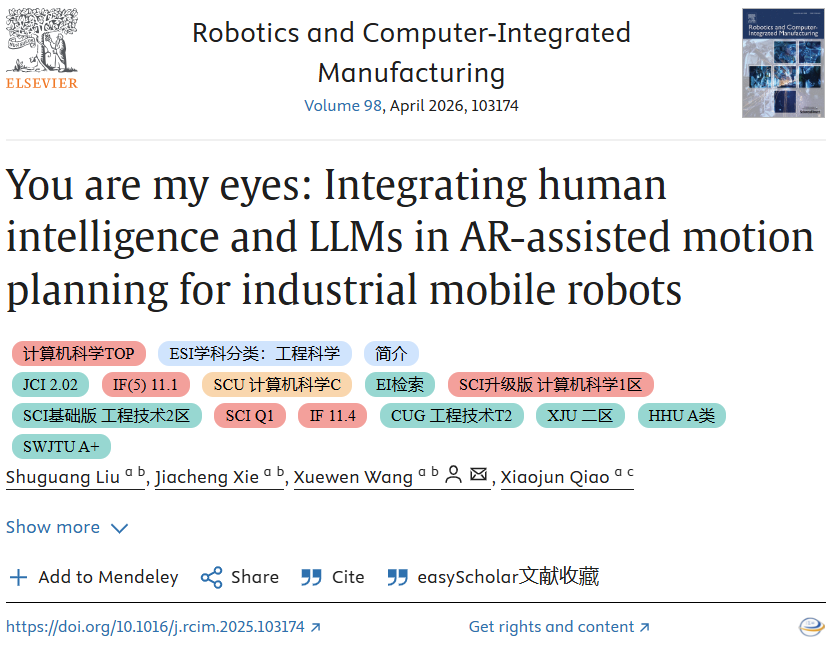

英文题目:You are my eyes: Integrating human intelligence and LLMs in AR-assisted motion planning for industrial mobile robots

中文题目:你是我的眼睛:融合人类智能与大语言模型的工业移动机器人AR辅助运动规划方法

作者:Shuguang Liu, Jiacheng Xie, Xuewen Wang, Xiaojun Qiao

作者单位:太原理工大学机械工程学院;太原理工大学山西省全机械化采煤装备重点实验室;山西太重工程机械有限公司

期刊:Robotics and Computer-Integrated Manufacturing

发表时间:2025年10月30日

引文格式:Liu S., Xie J., Wang X., and Qiao X., You are my eyes: Integrating human intelligence and LLMs in AR-assisted motion planning for industrial mobile robots, Robotics and Computer-Integrated Manufacturing, vol. 98, 103174, 2026.

01 全文速览

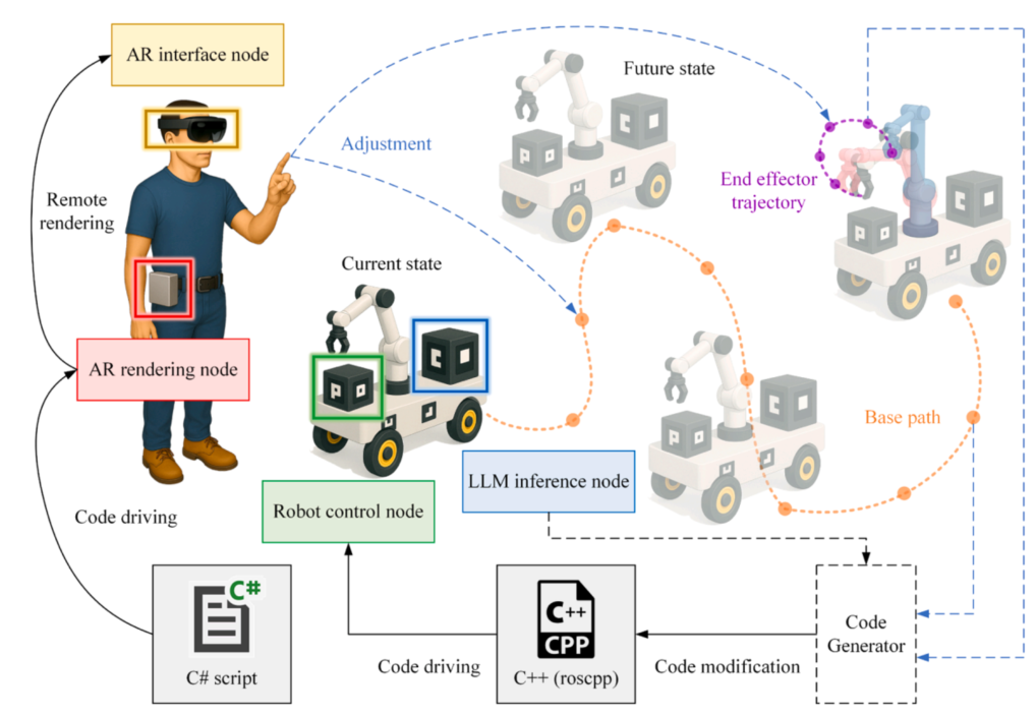

工业机器人运动规划正在迎来一个很有意思的转折:过去我们希望AI自己看懂现场、理解任务、生成动作,但在真实工业环境中,设备复杂、对象不规则、遮挡严重、语义专业,VLM/LLM未必真正懂现场。强行依赖模型自主感知,往往意味着微调、RAG、专用数据集和高部署成本。

这篇论文提出的路线更务实:不要让LLM自己看工业现场,而是让人通过AR把看见什么、哪里能抓、哪里有障碍标出来,再交给LLM做推理与规划。 这就是题目中You are my eyes的含义:人是LLM的眼睛,AR是人类感知结果进入机器人决策链的接口。

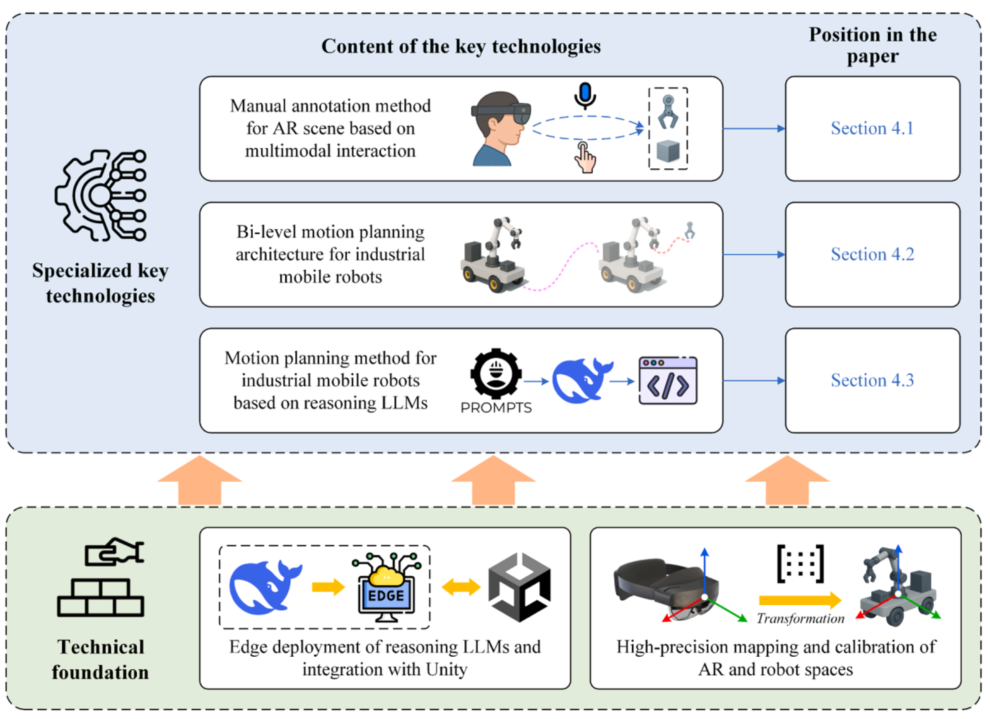

图1:整体框架图。

✅ 亮点1:将主流AI自主感知+决策拆解为人类感知+人机混合决策。

✅ 亮点2:通过AR手势与语音标注,将人的空间判断转化为LLM可理解的几何与语义信息。

✅ 亮点3:提出工业移动机器人两级运动规划架构,约束LLM推理,提高规划可行性。

✅ 亮点4:机械设备维护PoC验证了低成本、高可靠和零样本迁移潜力。

02 研究内容

🎯 2.1 为什么工业现场不能简单依赖VLM?

LLM与VLM结合在厨房、办公室等日常场景中已经表现不错,但工业场景完全不同。矿山装备、机械部件、维修工具、夹持位姿、危险区域,这些对象并不一定在通用互联网数据中充分出现。模型看不懂,后续规划就容易错。

论文的思路不是继续堆数据,而是让具备现场经验的人完成感知判断:人负责识别目标、障碍和合理末端姿态;LLM负责根据这些结构化条件进行规划与代码生成。这种分工更符合Industry 5.0强调的人本协作与人机混合增强智能思想。

🧠 2.2 四节点分布式边缘框架

论文构建了一个分布式边缘系统,避免将所有任务集中在云端或单机上。

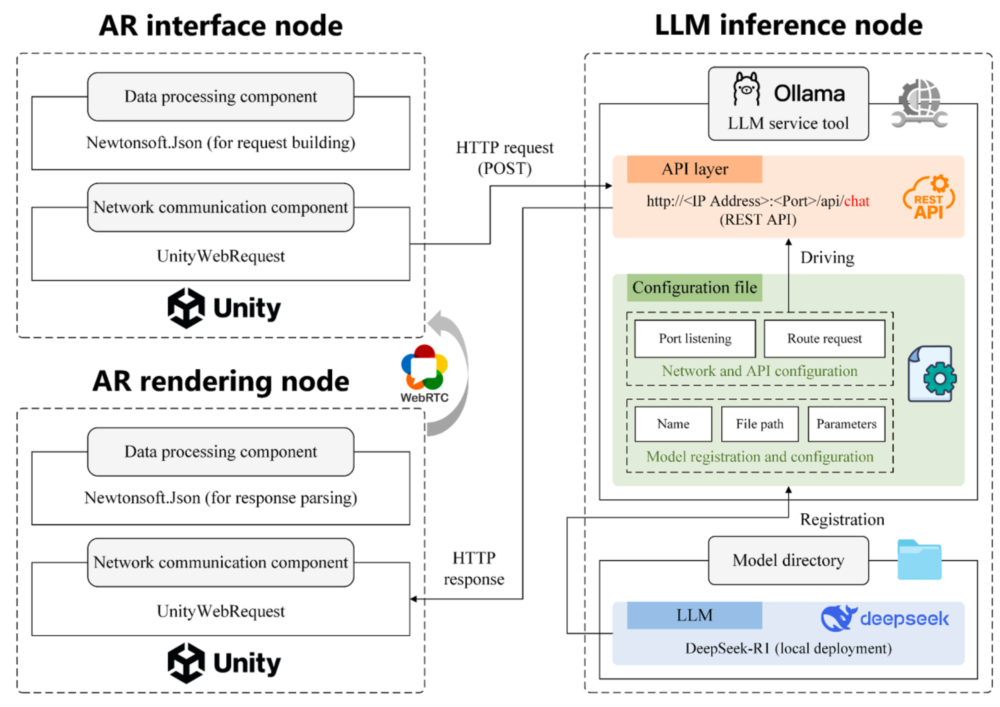

AR接口节点由操作员佩戴AR眼镜完成,负责手势、语音、虚实交互和提示词生成;AR渲染节点负责数字孪生预演和远程渲染;LLM推理节点部署DeepSeek-R1等推理模型,并完成运动规划和代码生成;机器人控制节点基于ROS执行最终控制。

图2:上图展示技术栈,下图展示推理LLM边缘部署及与Unity集成。

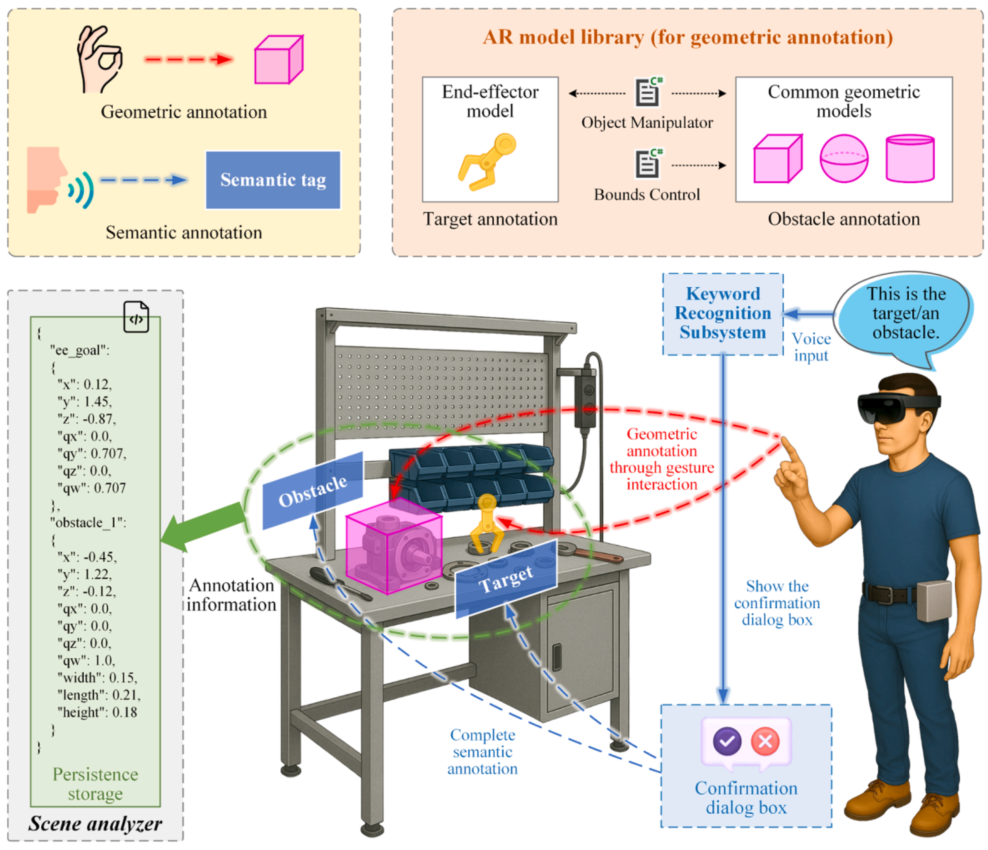

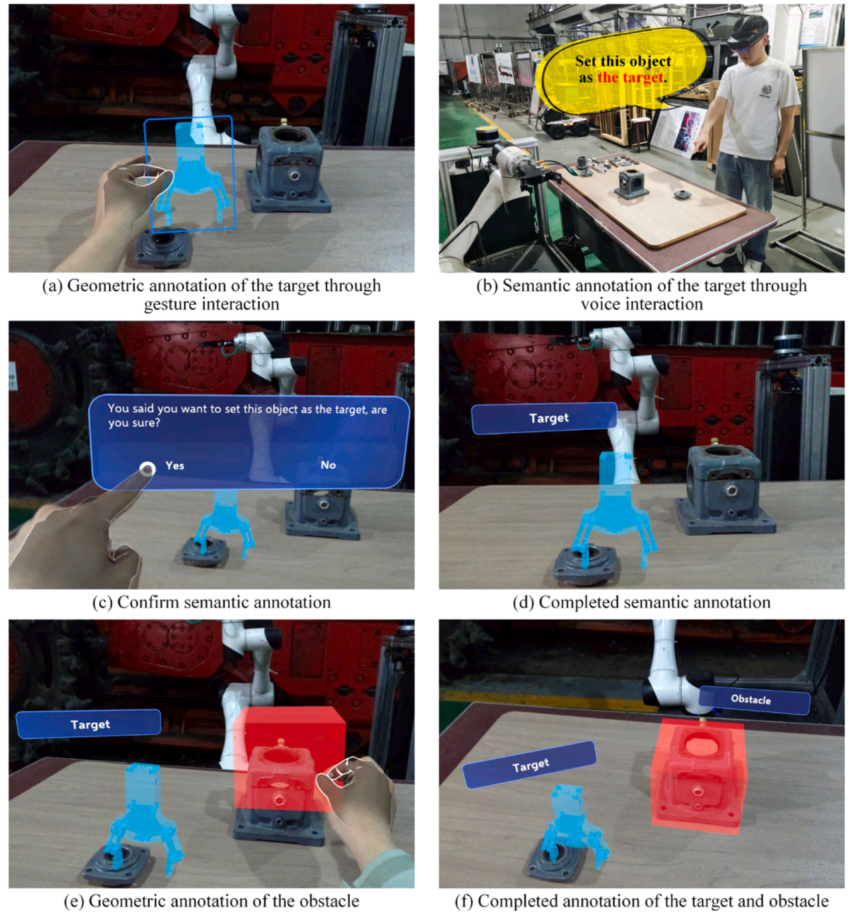

🕶️ 2.3 AR标注:把人的经验变成机器可读信息

AR场景手动标注是本文最核心的入口。操作员通过手势放置虚拟模型完成几何标注,通过语音完成语义标注。例如,直接把虚拟末端执行器摆到目标工件上,表示我希望机器人以这个姿态去抓取;再通过语音说Set this object as the target,系统确认后写入Target标签。

这种设计很巧妙:它不是让LLM猜这个不规则零件哪里能抓,而是让人直接把合理抓取位姿告诉系统。

图3:上图展示AR多模态标注原理,下图展示目标与障碍物标注过程。

论文还测试了标注可靠性:以减速器端盖为目标进行100次抓取实验,成功率达到 97%,说明该AR标注精度足以支持机器人实际操作。

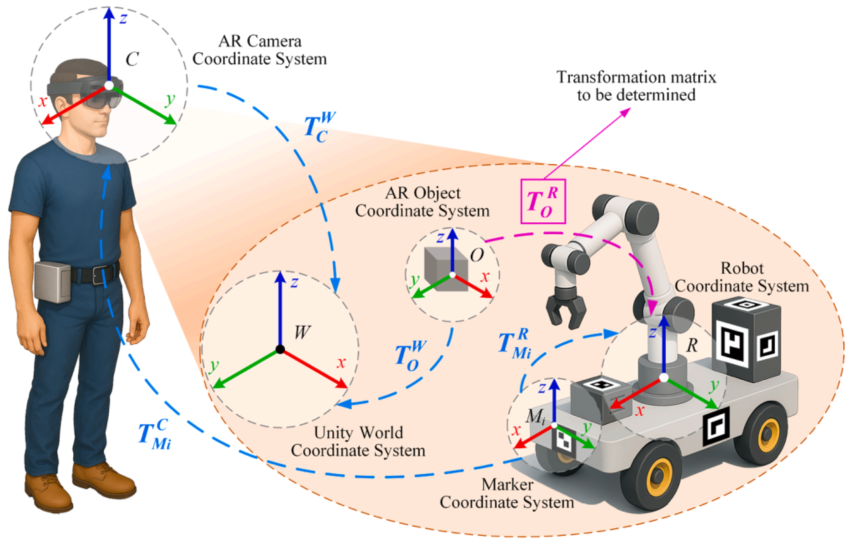

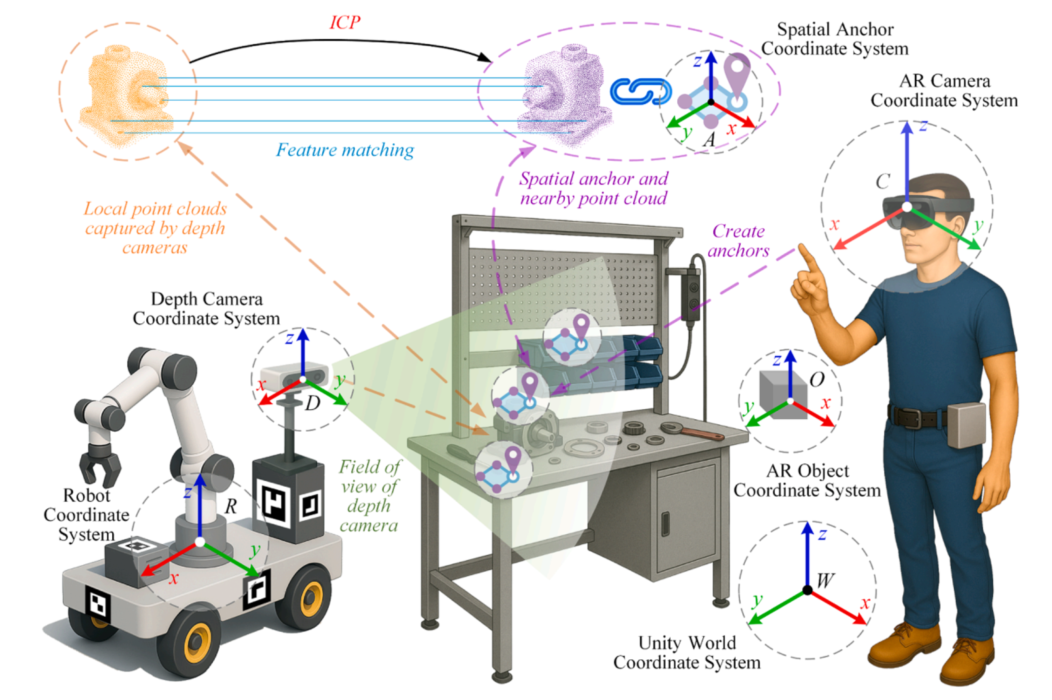

🧭 2.4 AR空间与机器人空间如何对齐?

AR里标的点必须能被机器人准确理解,因此论文设计了混合注册方法。主方法是在机器人上布置多个Marker,通过AR摄像头识别Marker,求解AR空间与机器人坐标系之间的变换关系。核心变换可概括为:

当光照过暗、过亮或Marker不可见时,系统切换到空间锚点与局部点云注册,通过ICP对齐AR局部点云与机器人深度相机点云,提高复杂环境下的鲁棒性。

图4:上图展示基于多Marker的注册,下图展示空间锚点与局部点云注册。

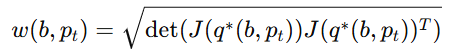

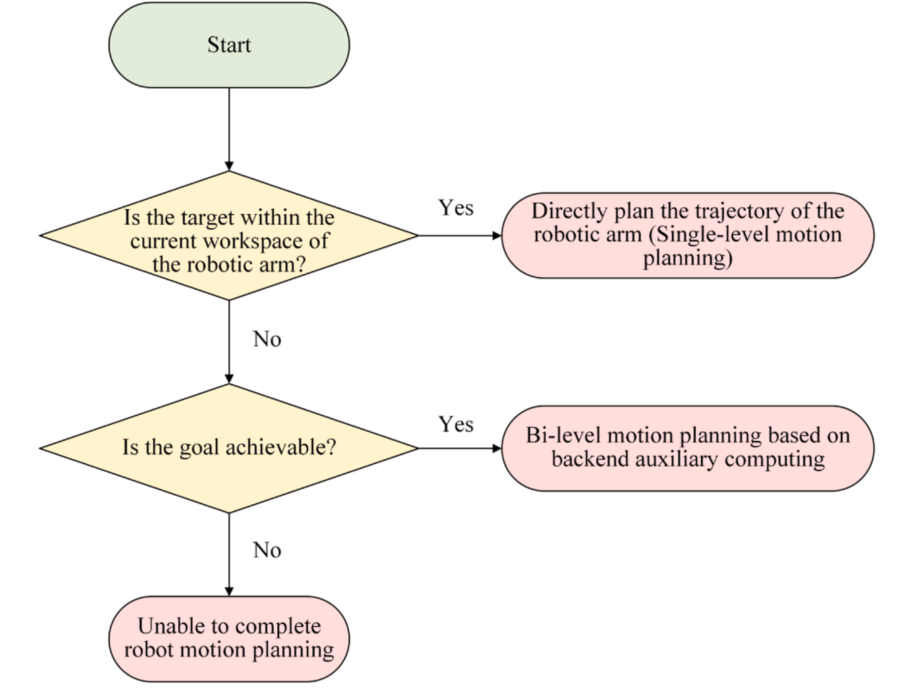

⚙️ 2.5 两级运动规划:先判断底盘是否需要动

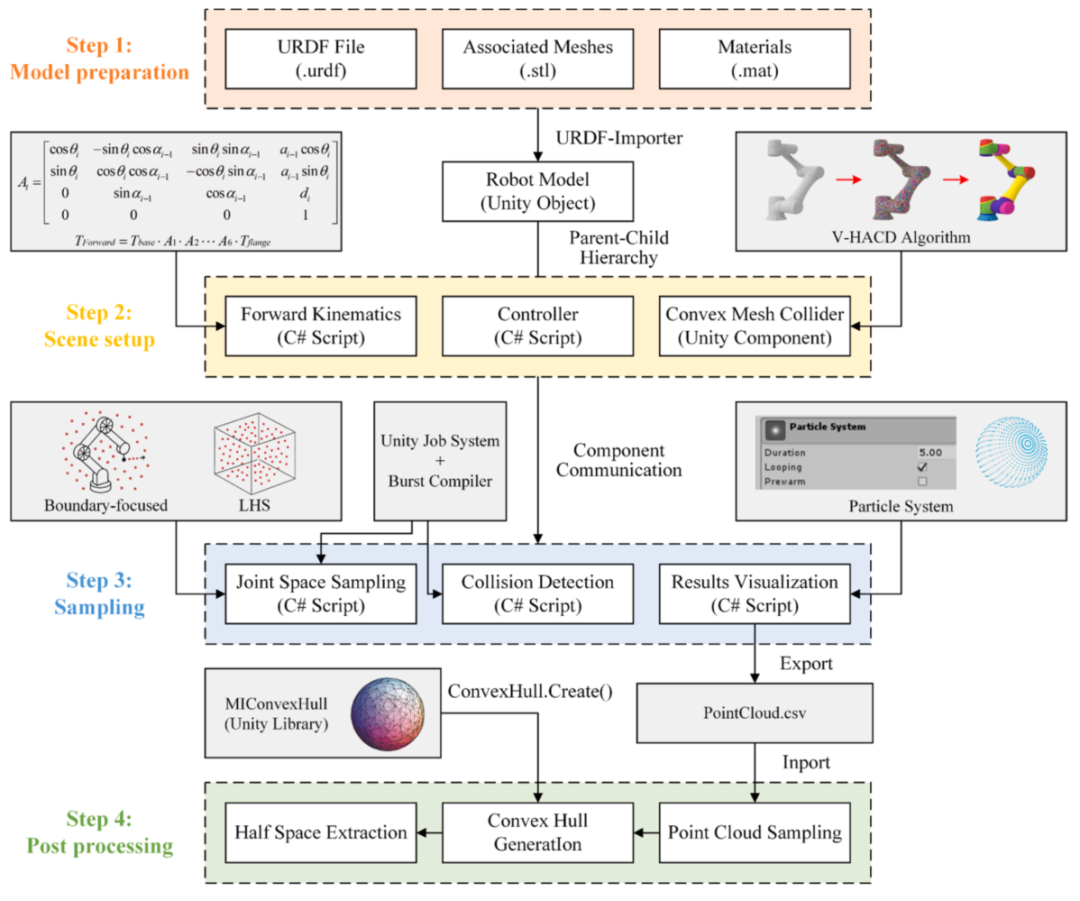

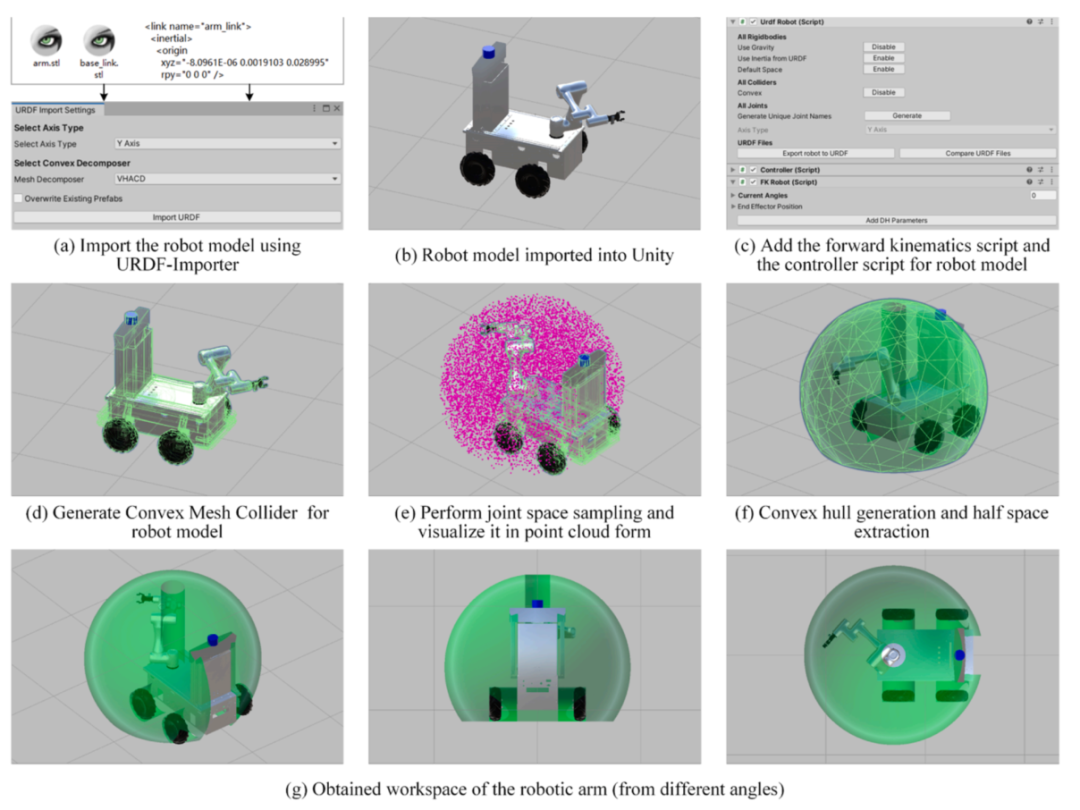

工业移动机器人通常由移动底盘和机械臂组成。如果直接让LLM整体规划,会遇到高维耦合、约束复杂、结果不稳定等问题。作者提出两级规划架构:上层规划底盘路径与停止位姿,下层规划机械臂轨迹。

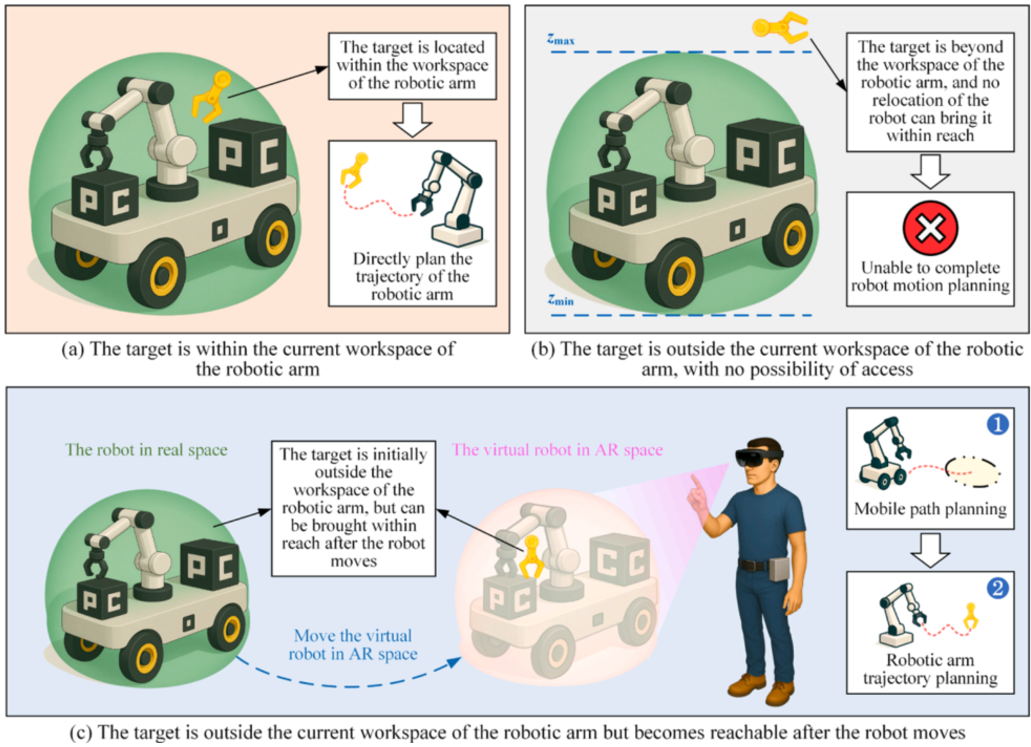

首先离线求解机械臂工作空间。作者在Unity中导入URDF模型,结合正运动学、碰撞检测、边界采样与拉丁超立方采样,得到机械臂可达点云,再生成凸包与半空间约束。相关伪代码包括 Algorithm 1 混合工作空间采样 和 Algorithm 2 工作空间后处理。

图5:上图为工作空间离线求解流程,下图为Unity中实际实现效果。

在线阶段,系统判断目标是否在当前机械臂工作空间内。如果在,只做机械臂轨迹规划;如果不在,再判断目标高度是否处于可达范围:

若 (R=0),说明机器人无法完成任务,需要人来处理;若 (R=1),进入底盘+机械臂两级规划。同时,系统用可操作度指标选择较优底盘停止位姿:

图6:上图为在线规划分类流程,中图为两级规划原理,下图为AR界面中的实际准备过程。

🤖 2.6 LLM规划与代码生成:从提示词到执行代码

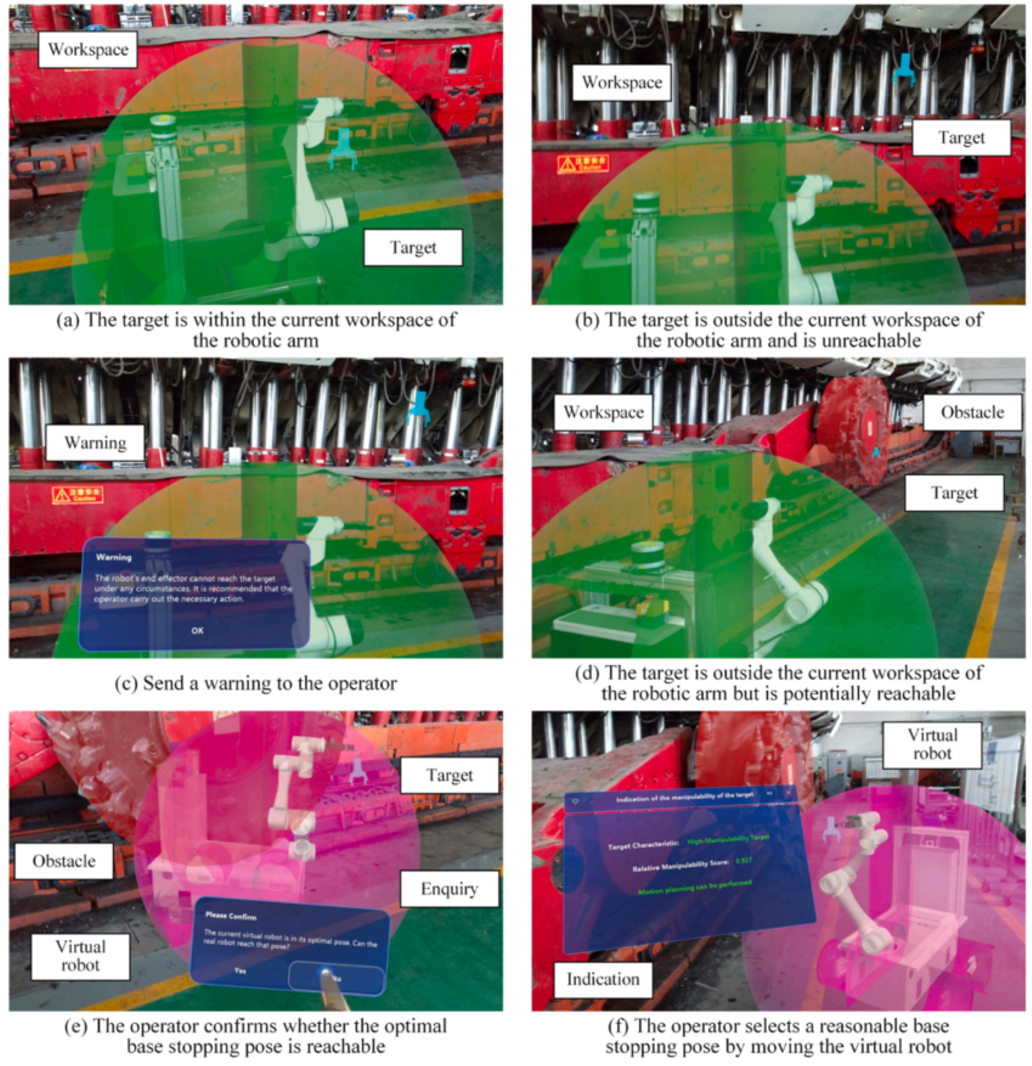

AR标注完成后,系统将目标、障碍物、机器人位姿、两级规划规则和用户语音输入组合为Prompt。LLM先生成高层运动计划,再由代码生成模块基于模板生成C脚本和C++控制代码。C用于数字孪生预演和AR可视化,C++用于最终ROS机器人控制。

值得注意的是,机器人不会直接执行LLM生成的结果,而是先在AR中预演。操作员可以检查底盘路径、机械臂轨迹和关键帧,如果发现风险,可拖动关键点修改。确认后,系统再更新代码并驱动实机执行。

图7:运动计划渲染、修改与执行过程。

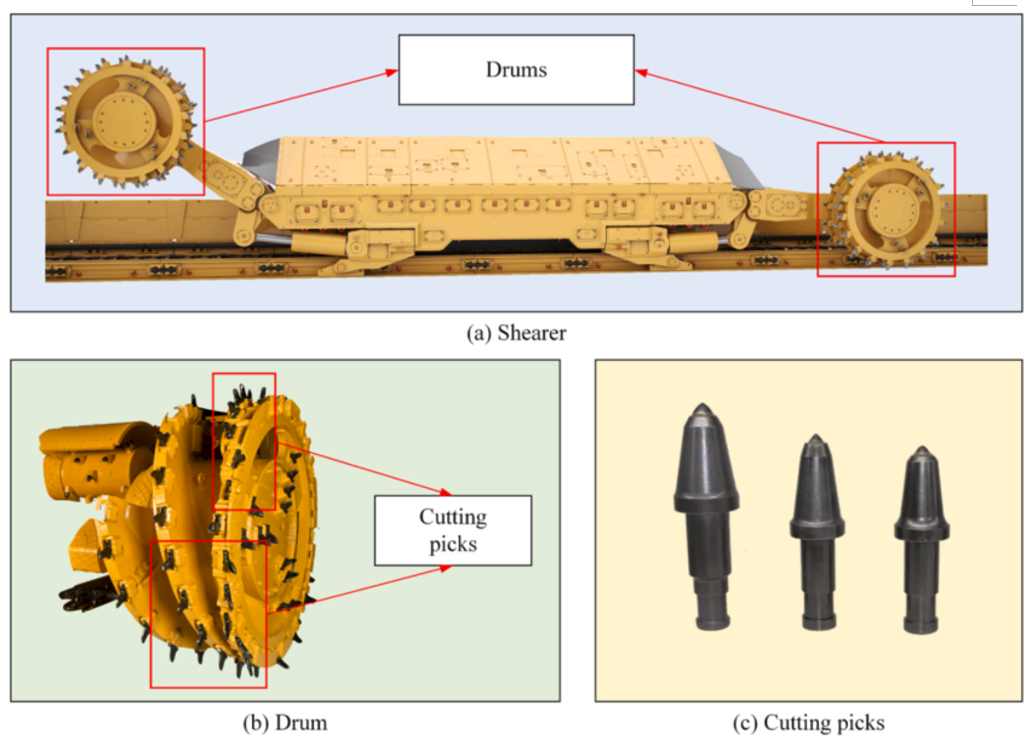

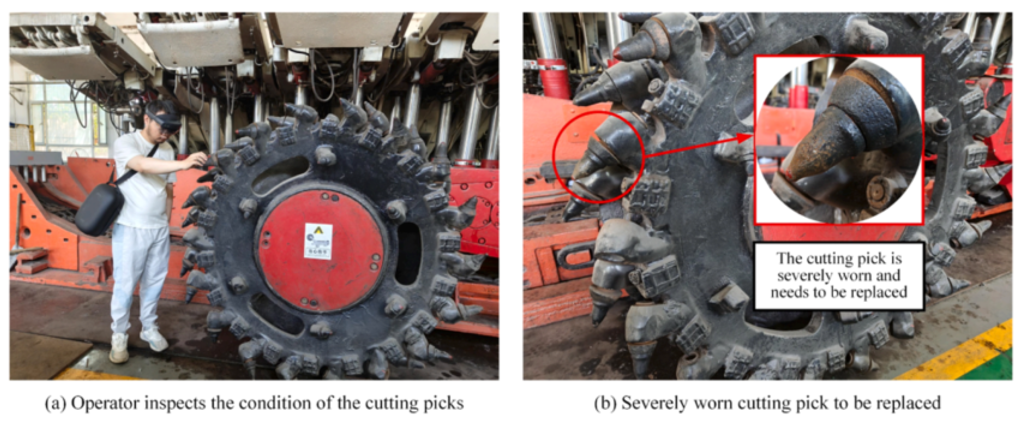

🏭 2.7 机械设备维护PoC:从割煤机截齿更换验证方法可行性

论文选择机械设备维护作为PoC场景,原因是该场景高度非结构化、任务变化大、安全要求高,非常适合验证人机混合智能。案例围绕采煤机截齿更换展开,任务被分解为旧截齿拆卸和新截齿安装:抓取旧截齿、放到工作台、抓取新截齿、安装到截齿座。

图8:上图展示采煤机结构,下图展示截齿检查与任务确认。

实验表明,LLM能够根据目标与工作空间关系合理选择单级或两级规划;四个动作的规划和代码生成速度均在可接受范围内;AR可视化结果与真实底盘路径、机械臂轨迹基本一致。更重要的是,整个过程不需要工业知识微调或RAG,显著降低了部署准备成本。论文还报告人机交互频率达到 4.9次/分钟,说明该系统支持较高频、低摩擦的现场微交互。

03 创新点

🔍 3.1 把模型看现场改成人给模型看现场

本文最有启发的地方在于范式转换:不再要求VLM独立理解复杂工业场景,而是由人通过AR把感知结果传给LLM。这降低了对工业视觉大模型的依赖。

🧩 3.2 AR不只是显示器,而是人机混合决策接口

AR承担了标注、预演、修改和确认四类功能,使人类经验能够实时进入运动规划闭环。

⚙️ 3.3 两级规划架构给LLM加上工程边界

通过机械臂工作空间、可达性判断、可操作度评分和底盘停止位姿选择,LLM推理被限制在更可靠的工程规则内。

🛡️ 3.4 本地LLM部署增强工业可靠性与安全性

论文使用Ollama在边缘节点部署推理LLM,减少云端依赖,提升响应速度、数据安全和现场可用性。

04 总结与展望

这篇论文的价值不在于把LLM包装成一个万能机器人规划器,而是提出了一种更接近工业现实的路线:让人负责现场理解,让LLM负责规则推理,让AR负责连接人与机器。 这条路线非常适合维护、装配、巡检等非结构化工业任务。

🔭 未来研究将聚焦于以下几个方向:

1. 提升AR标注精度与交互效率,减少复杂现场中的误标和重复确认;

2. 扩展更多工业场景验证,如设备巡检、应急抢修、柔性装配和井下辅助作业;

3. 增强LLM规划结果的形式化安全校验,避免代码生成中的隐性风险;

4. 融合视觉、力觉与语言反馈,形成更完整的人机协同闭环;

5. 探索多机器人协同AR标注与LLM规划,面向更复杂的工业集群任务。

声明:本文仅供学术交流,版权归原作者所有。如有错误或侵权,请联系更正或删除,欢迎留言探讨。