AI算力背后的真相:数据中心互联架构全拆解

🧠核心主题翻译

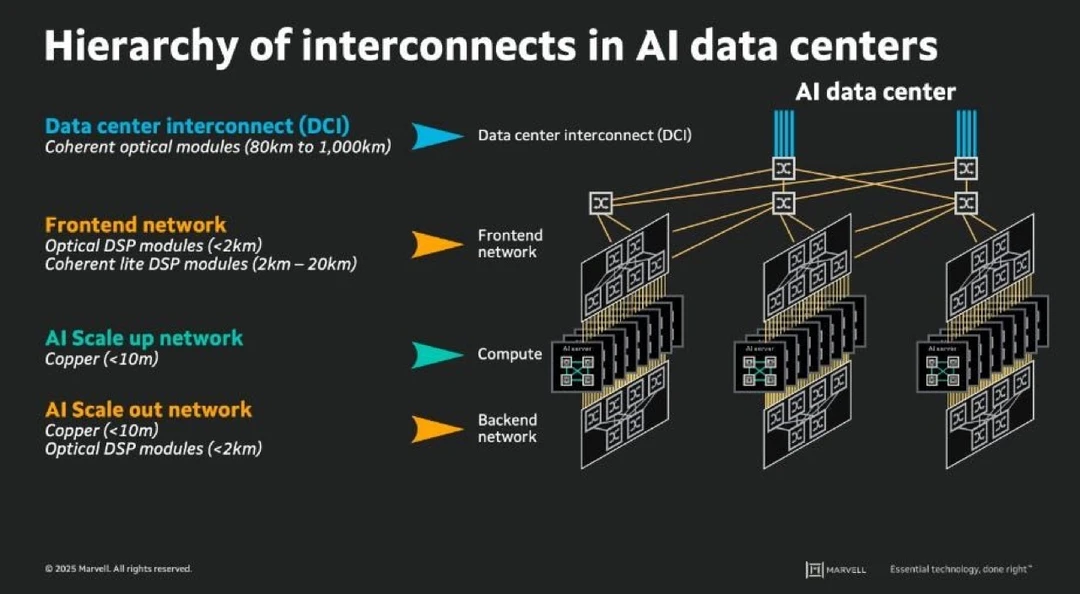

这张图展示的是AI数据中心内部与之间的“互联层级结构”,也就是算力如何通过不同网络被连接、放大与调度。

🌐数据中心互联层

数据中心互联用于连接不同城市甚至跨区域的数据中心,通常采用相干光模块,传输距离大约在80公里到1000公里之间。这一层决定了全球算力如何流动,是云计算和大模型部署的基础。

🔗前端网络

前端网络负责用户请求与数据中心之间的连接,主要使用光DSP模块。短距离场景小于2公里,中距离大约2到20公里。这一层直接影响用户访问速度和响应延迟。

⚡AI扩展网络

在单个数据中心内部,AI扩展网络用于连接GPU或计算节点之间的高速通信。通常采用铜缆连接,距离非常短,小于10米。这一层决定模型训练效率,是算力密度的核心。

📡AI横向扩展网络

当计算规模扩大,需要跨多个服务器或机架时,就依赖横向扩展网络。它同样使用铜缆或短距离光模块,实现不同计算集群之间的数据交换。这一层决定系统的扩展能力。

🖥整体架构逻辑

整个AI数据中心可以分为三个关键层级

最上层是前端网络,负责接入用户请求

中间是计算层,承担模型训练与推理

底层是后端网络,负责大规模数据同步与节点通信

🚀技术本质解读

AI算力的竞争,不只是芯片性能,更是“连接效率”。

谁能让GPU之间通信更快,谁就能训练更大的模型。

谁能降低延迟和带宽瓶颈,谁就能提升整体系统性能。

📊行业意义

随着大模型规模不断扩大,数据中心互联的重要性迅速提升。

从光模块到高速互联协议,这一领域正在成为新的技术竞争核心。

📌总结

AI时代的基础设施不只是算力芯片,而是完整的网络体系。从城市级互联到机架级连接,每一层都在决定最终的性能上限。真正的壁垒,是把这些层级无缝打通的能力。